速递|Mythos带来AI安全压力,欧洲银行联手Mistral开发本土AI网络安全模型

速递|Mythos带来AI安全压力,欧洲银行联手Mistral开发本土AI网络安全模型法国巴黎银行正与法国人工智能初创公司 Mistral AI 及其他合作伙伴合作,为应对 Anthropic 旗下 Mythos 等新模型带来的网络安全威胁做准备。

搜索

搜索

法国巴黎银行正与法国人工智能初创公司 Mistral AI 及其他合作伙伴合作,为应对 Anthropic 旗下 Mythos 等新模型带来的网络安全威胁做准备。

SpaceX 2025 年全年营收是187 亿美元。这是这家火箭公司用了 23 年积累下来的成果——从 2002 年创立,到把猎鹰 9 号变成最可靠的运载火箭,再到星链卫星互联网,23 年换来的年收入数字。然后 Anthropic 来了一份合同:每年 150 亿美元。

Anthropic 到底是在哪个节点后来居上,和 OpenAI 拉开距离的?「海外独角兽」的这篇文章,从战略和组织这两个角度,对 Anthropic 的发展做了一次详尽的梳理和还原,分析了:

教宗利奥十四世将于 5 月 26 日发布任期首份通谕,主题直指 AI,Anthropic 联合创始人、Claude 缔造者 Chris Olah 受邀同台。梵蒂冈同步成立 AI 委员会。一个两千年的古老机构,正试图用道德权威填补 AI 治理的真空——它覆盖的人口,比任何一部 AI 法案的管辖范围都大。

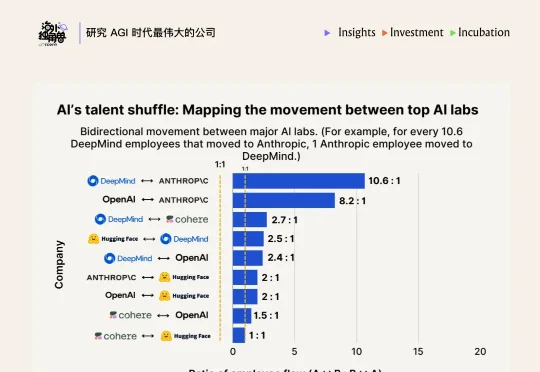

5 月 19 日,OpenAI 联合创始人、「Vibe Coding」之父 Andrej Karpathy 宣布加入 Anthropic 预训练团队。他将组建新团队,用 Claude 加速预训练研究。一个做过Hinton和李飞飞学生、奥特曼同事、马斯克直属下属的人,为什么甘愿做 Dario Amodei 的「-2」?Anthropic 又为什么非要招他?

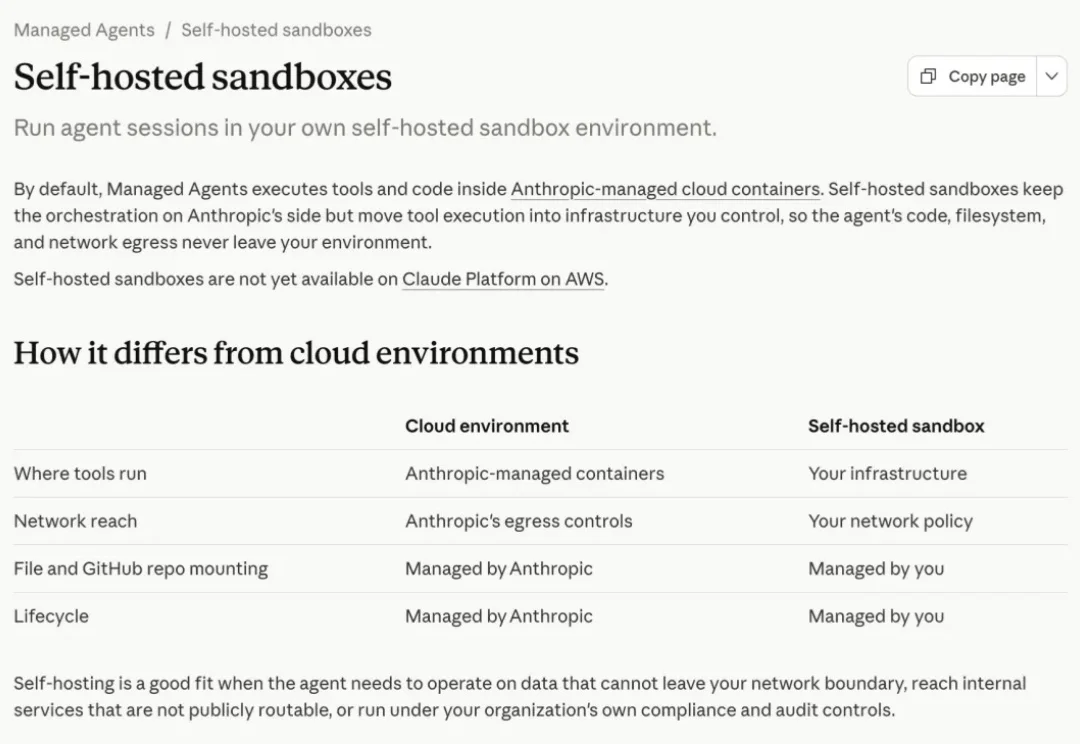

刚刚 Anthropic 又给他们的官方 Managed Agents 加了俩功能:自托管沙箱 self-hosted sandboxes 和 MCP 隧道 MCP tunnels

OpenAI 的两大宿敌 Anthropic 和马斯克,放下心中成见之后终于在月初结盟了。

在达沃斯世界经济论坛上,《华尔街日报》总编辑 Emma Tucker 在 Journal House 跟 Anthropic CEO 阿莫迪聊了半个多小时

上周,Anthropic 一口气做了三件事。 单看任何一件,都可以说是"正常的商业合作"。但 Reid Hoffman——LinkedIn 联合创始人,投过 OpenAI 的早期,现在是 Micros

Anthropic 刚刚出了一份 36 页的创始人手册:创建一家 AI Native 的公司,几个人,做几百人的事儿。由着这个问题,手册把创业拆成四个阶段(想法、MVP、上线、规模化),每个阶段讲清楚该做什么、容易踩什么坑、Claude 的三个产品形态(Chat、Cowork、Code)分别在什么时候用